近日,自然通讯(Nature Communications)发表了上海交通大学人工智能学院智慧医疗团队的最新研究工作。研究团队构建并发布了一个大规模的互联网多模态放射学影像数据集,包含4万+临床案例,5千+疾病种类,涵盖7种解剖部位和9种成像模态,并据此训练和开源了一个多模态、跨部位、多病种的病例级放射学综合诊断基础模型,在超过20个外部数据集上展现出了优越的性能。该工作在多模态放射学影像研究和长尾疾病诊断方面为领域的发展提供了宝贵的基础资源和全新的研究思路。

在临床医学中,精准诊断是有效治疗的必要条件,而基于放射影像学的疾病诊断在临床实践中具有重要意义。然而,现有的医疗影像诊断模型面临着多重挑战:模型往往局限于单一疾病领域和单一影像模态,缺乏对疾病的深层理解和背景知识的整合;不同数据集之间也缺乏统一的疾病定义标准。针对这些问题,研究团队构建了一个大规模的放射学诊断数据集,涵盖5568种疾病或异常,及其对应的930种ICD-10-CM编码,包含40936个临床病例(共195010份扫描),涵盖9种成像模态和7个人体解剖部位。据此,研究团队提出了一种能够处理多模态、任意数量输入扫描的知识增强模型架构,并建立了相应的多维度评测基准。实验表明,该模型在多项基准测试中性能优越,为临床实践中的精准诊断和罕见病医学研究提供了重要基础支持。

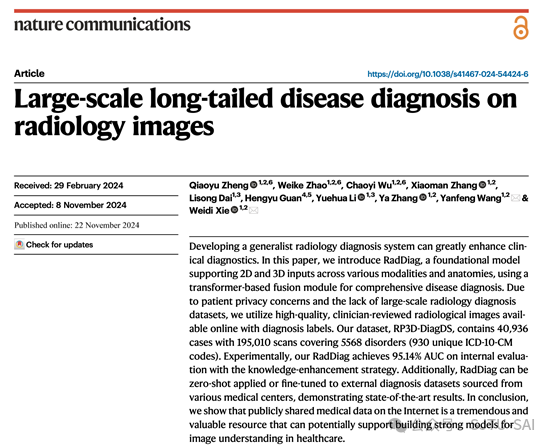

图1: RP3D-DiagDS数据集构建流程:从Radiopaedia爬取原始数据,经过大语言模型初筛和临床医生复核,最终完成ICD-10-CM标准化标注

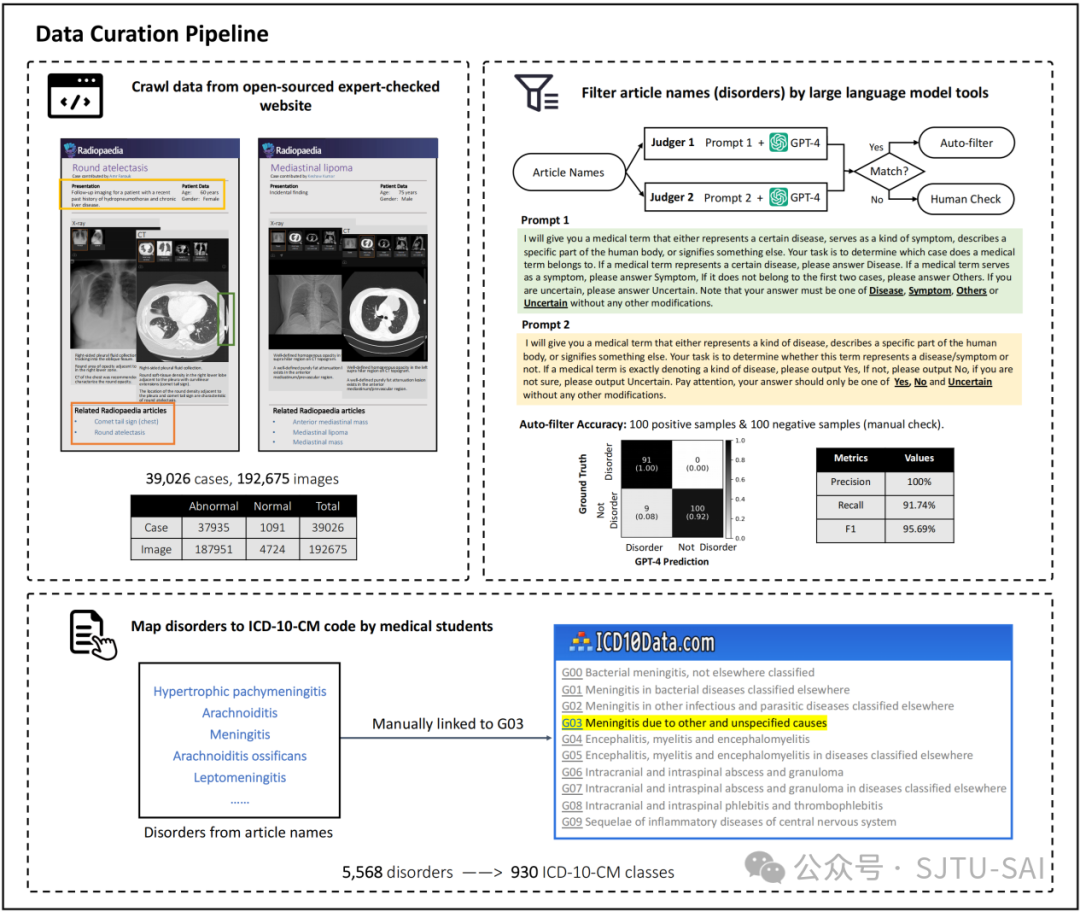

在数据集收集与整理方面,研究团队基于Radiopaedia(一个大型放射学百科网站)构建了目前最大规模的多模态放射影像诊断数据集RP3D-DiagDS。该数据集的构建分为三个关键步骤:互联网数据爬取、基于大型语言模型与临床医生的双重筛选、以及基于ICD-10-CM国际通用编码的标准化处理。最终收集的数据集包含超4万个临床案例,涵盖了9种不同的成像模态(包括CT、MRI、X光等)和7个主要解剖部位(如头颈、胸部、腹部等)。数据分析显示,约22%的病例包含多模态图像,其中以头颈部和腹部盆腔的病例占比最大。在疾病覆盖方面,数据集呈现出典型的长尾分布特征,共涵盖了5568种疾病,对应930种ICD-10-CM编码。

图2: RP3D-DiagDS数据分布

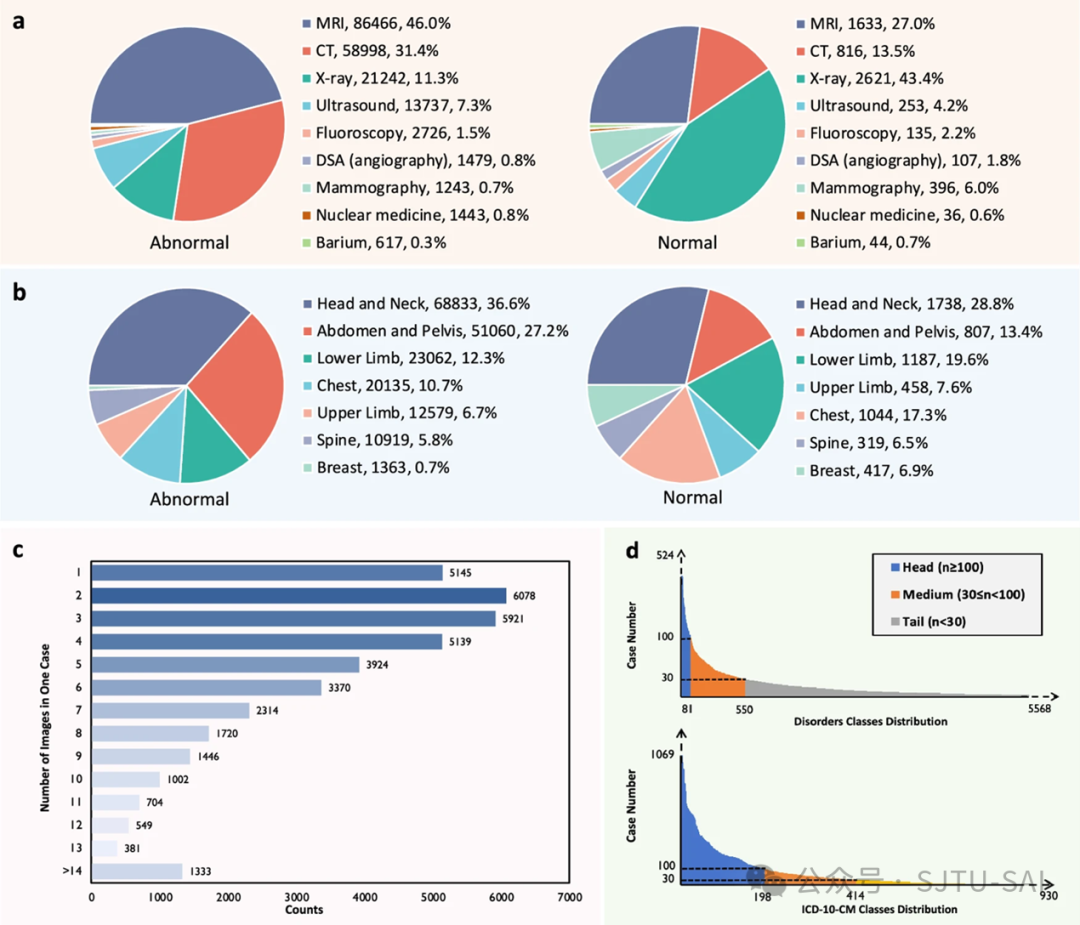

在放射学诊断模型搭建方面,研究团队设计了一个多标签、多分类诊断模型框架,整合了三个关键技术模块:采用ResNet-ViT混合架构实现2D和3D医疗影像的统一处理,设计Fusion模块支持多张影像的综合分析,并结合知识增强策略建模疾病间的关联关系,有效缓解了疾病数据长尾分布的挑战。

图3: RP3D-DiagModel包含三个核心组件:(a)基于ResNet-ViT的混合视觉编码器,(b)基于Transformer的多图像融合模块,(c)整合医学知识的知识增强分类器

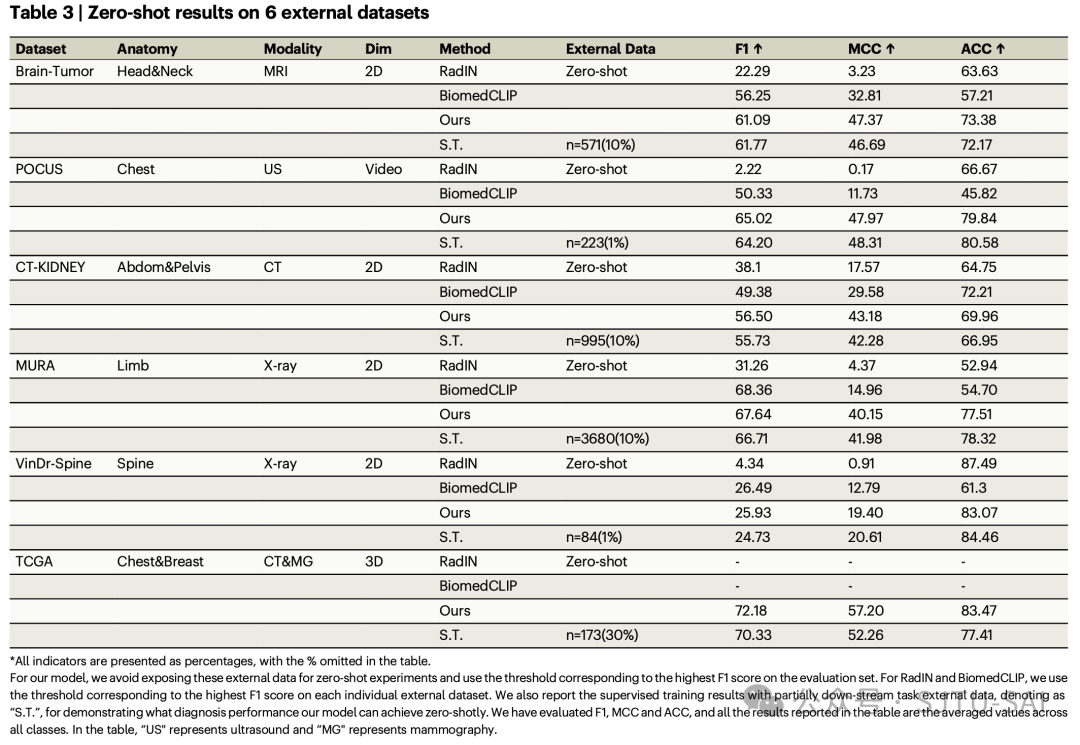

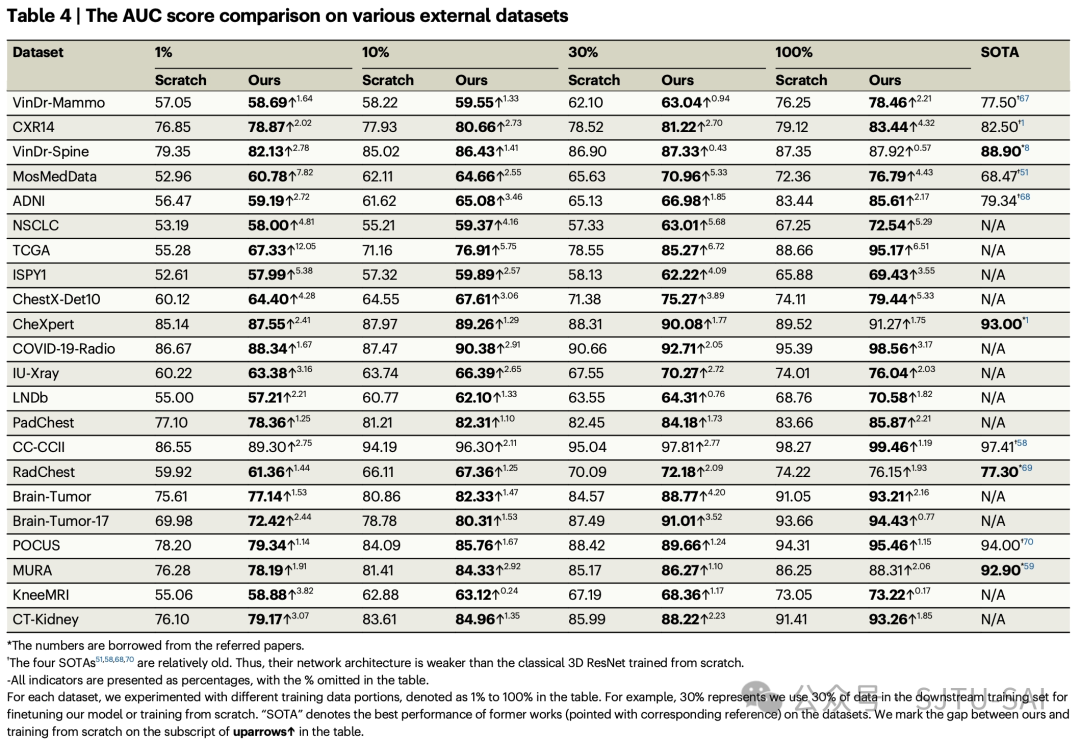

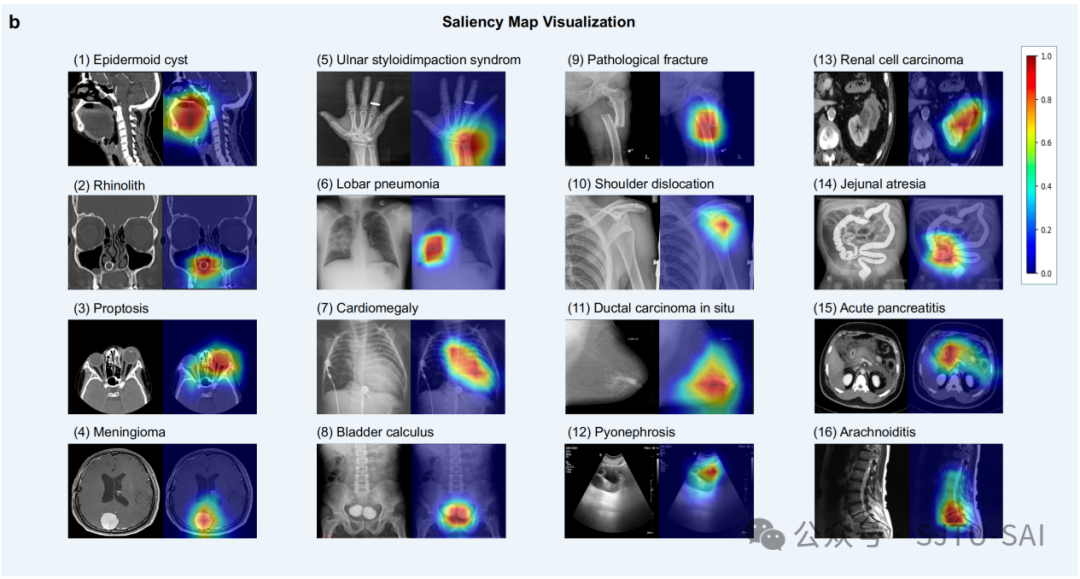

在评测基准构建方面,研究团队通过多个维度全面评估了模型性能,核心包括:(1)在zero-shot测试中,模型在5个外部数据集(涵盖9634个不同解剖部位的病例)上均优于RadImageNet和BiomedCLIP等现有模型;(2)在22个外部数据集的few-shot迁移学习实验中,模型展现出强大的迁移能力,多数情况下足以超越针对特定数据设计的专有SOTA模型;(3)通过EigenGradCAM生成的显著性图分析表明,模型在多数情况下能够准确定位不同解剖部位和成像模态下的病变区域,展现出良好的诊断可解释性。

图4: 六个外部临床数据集上的zero-shot实验对比

图5: 22个外部临床数据集上的few-shot实验对比

图6: 关键帧的显著性图。红色表示模型在推断相应疾病类别时关注的区域。这表明 RadDiag 能够准确识别病变或异常区域的位置

研究通过构建大规模多模态数据集RP3D-DiagDS及其诊断模型,实现了病例级的综合诊断能力,提出了针对长尾分布疾病诊断的有效优化路径,并展现出良好的迁移学习潜力。在未来的研究中,还将提升模型在极端罕见疾病的诊断效果,以及需要整合更多临床信息(如文本等其他模态信息)以提升诊断准确性。

上海交通大学博士生郑乔予,赵唯珂和吴超逸为论文的共同第一作者,上海交通大学人工智能学院王延峰教授和谢伟迪副教授为论文的共同通讯作者。该研究得到了中国国家重点研发计划(2022ZD0160702)上海市科委(22511106101、18DZ2270700、21DZ1100100)、111计划(BP0719010)以及超高清视音频制播呈现国家重点实验室的支持。